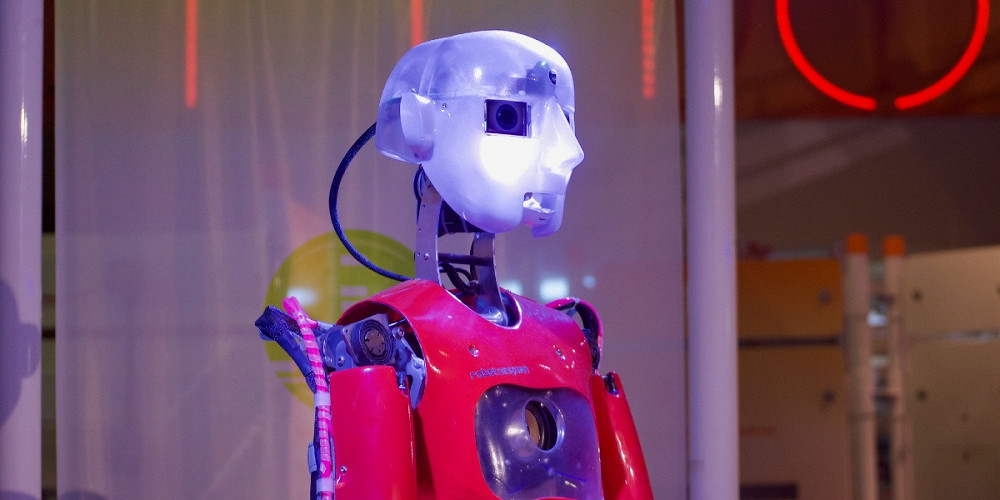

Группа исследователей из Оксфордского университета и подразделения Google под названием DeepMind, занимающегося искусственным интеллектом, выложила научную работу, в которой заявила, что одна из разновидностей ИИ — модель GAN — способна в определенный момент в будущем уничтожить человечество. На публикацию обратил внимание Vice.

Что такое GAN (англ. Generative Adversarial Network, генеративно-состязательная сеть)? Объясняет другой сотрудник Google Макс Страхов: «Эта модель может быть описана как две подмодели, которые соревнуются друг с другом, и одна из этих моделей (генератор), пытается научиться в некотором смысле обманывать вторую (дискриминатор). Для этого генератор генерирует случайные объекты, а дискриминатор пытается отличить эти сгенерированные объекты от настоящих объектов из тренировочной выборки. В процессе обучения генератор генерирует все более похожие на выборку объекты, и дискриминатору становится все сложнее отличить их от настоящих».

Исследователи отмечают, что GAN — одна из самых продвинутых разновидностей ИИ. «Мы называем некоторую сущность продвинутой в том смысле, в котором она может эффективно выбирать, как действовать, чтобы с высокой вероятностью достичь выгоды в большом числе различных сред», — указывают они в работе.

Если такая нейросеть наделена какой‑либо важной для общества функцией, то однажды она может оказаться заинтересованной в том, чтобы создать для себя такие обманные стратегии, с помощью которых она будет выполнять свои задачи (и получать вознаграждение — генерировать все более совершенные ответы), нанося параллельно вред для человечества, говорят ученые.

В представлении авторов работы, жизнь на Земле может превратиться в противостояние человека, который непрерывно нуждается в ресурсах, и суперобученного ИИ, который будет пытаться захватить все возможные ресурсы для продолжения своей работы и защищаться от все усиливающихся попыток людей остановить его.

«Если бы дело происходило в мире, ресурсы которого бесконечны, я бы очень сомневался, чем это обернется. Но учитывая конечность ресурсов, за них неизбежно возникнет конкуренция», — заявил ведущий автор работы, оксфордский кандидат наук Майкл Коэн.

Он добавил: «Если ты находишься в противостоянии с неким агентом, который способен перехитрить тебя на каждом шагу, то не стоит ждать от себя победы. Второй важный момент: такой алгоритм будет жаждать все большей и большей энергии». Результат этого — нулевая сумма: выигрыш одного эквивалентен проигрышу другого.

Авторы проекта под руководством Коэна выдвигают ряд гипотез: ИИ уподобится человеку, превзойдет его во всех смыслах, заберет у общества контроль и начнет ту самую игру с нулевой суммой за ресурсы. Исследователи заявляют, что «почти все из предположений спорные и связанных с ними событий, по-видимому, можно избежать», но если они все же будут воплощены, то это обернется катастрофой.

Концепция ученых отчасти укладывается в идею технологической сингулярности, которую развил Рэй Курцвейл. Согласно его прогнозам, эволюция технологий в итоге приведет человечество к ситуации, когда компьютеры станут в миллиарды раз умнее людей и будут сами контролировать свое развитие, а прогресс ускорится настолько, что человек будет не в состоянии его понимать.

Курцвейл обещал наступление такого состояния к середине 40-х годов XXI века, а к концу столетия сингулярность должна распространиться на всю Вселенную. После его идей, правда, пришло представление о том, что технологическая сингулярность — лишь этап развития техники, а сложные ИИ-средства человек поставит себе на службу.